Kurumsal Kubernetes Yolculuğunun Yeni Evresi

Kubernetes, modern kurumsal IT altyapısının tartışmasız merkezine yerleşmiş durumda. Container tabanlı uygulamaların yönetimi, ölçeklendirilmesi ve güvenliğinin sağlanması açısından Kubernetes, bugün neredeyse her büyük organizasyonun operasyonel stratejisinin ayrılmaz bir parçası haline geldi. Bu süreçte Red Hat OpenShift gibi platformlar, Kubernetes’in kurumsal ortamlarda hızla benimsenmesinde kilit bir rol oynadı. Enterprise-grade güvenlik politikaları, Governance araçları ve kapsamlı operasyonel toolchain’ler sunan OpenShift, özellikle Hybrid Cloud ve on-premises ortamlarda Container yönetimini standardize etmek isteyen organizasyonlar için güçlü bir tercih oldu.

Ancak Kubernetes ekosistemi ölçeklendikçe yeni ve daha karmaşık zorluklar ortaya çıkmaya başladı. Cluster deployment’ının ötesinde, ekiplerin yönetmesi gereken operasyonel yük dramatik biçimde arttı: birden fazla Cluster’ın yaşam döngüsü yönetimi, ağ politikalarının tutarlı uygulanması, depolama katmanlarının optimize edilmesi, güvenlik açıklarının tüm Workload’lar genelinde izlenmesi ve Multi-Cloud ortamlarda Compliance gereksinimlerinin karşılanması bunların yalnızca bir kısmı. İşte tam bu noktada VMware Cloud Foundation 9’ın sunduğu Unified Cloud Operating Model, sektörün dikkatini çekiyor ve OpenShift’ten VCF 9’a geçiş tartışmaları giderek daha stratejik bir boyut kazanıyor.

OpenShift’in Güçlü Yanları ve Operasyonel Gerçekler

Red Hat OpenShift’in kurumsal ortamlarda kazandığı güveni hafife almak doğru olmaz. OpenShift, yıllar içinde özellikle Microservices mimarisi benimseyen, DevOps ve GitOps pratiklerini operasyonlarına entegre etmek isteyen organizasyonlar için güçlü bir ekosistem oluşturdu. Operator Framework, OperatorHub üzerindeki zengin uygulama kataloğu, entegre CI/CD pipeline’ları ve güçlü RBAC mekanizmaları, OpenShift’i kurumsal Kubernetes dünyasının önemli bir oyuncusu yapmaya devam ediyor.

Bununla birlikte, OpenShift’in operasyonel model gerçeklikleri de göz ardı edilemez. OpenShift odaklı bir ekosistemde, Compute altyapısı, Storage, Network ve Kubernetes Orchestration katmanları genellikle farklı ekipler, farklı toolchain’ler ve farklı Governance süreçleriyle yönetilmektedir. Bu durum, özellikle büyük ölçekli kurumsal ortamlarda önemli bir operasyonel silolaşmaya yol açar. Bir Workload’un altyapı katmanından uygulama katmanına uzanan tam yaşam döngüsünü tek bir tutarlı Platform üzerinden yönetmek giderek zorlaşır. Ayrıca ESXi tabanlı sanal makinelerin ve Container’ların birlikte çalıştığı Hybrid ortamlarda, iki ayrı yönetim düzlemi arasındaki koordinasyon operasyonel maliyeti artırmaktadır.

CNCF’nin yayımladığı son raporlara göre, kurumsal Kubernetes kullanıcılarının %67’si operasyonel karmaşıklığı en büyük zorluk olarak işaret etmektedir. Bu rakam, “Kubernetes’i deploy ettik, peki şimdi nasıl yöneteceğiz?” sorusunun ne kadar evrensel olduğunu açıkça ortaya koymaktadır.

VMware Cloud Foundation 9 ve Unified Cloud Operating Model’in Anatomisi

VMware Cloud Foundation 9, Broadcom’un VCF portföyüne getirdiği en kapsamlı mimari dönüşümü temsil etmektedir. Bu versiyonun merkezi vaadi, Unified Cloud Operating Model kavramıdır; yani Compute, Storage, Network ve Kubernetes Orchestration’ı tek bir entegre Platform altında yönetebilme yeteneği. VCF 9 ile birlikte vSphere, vSAN, NSX ve Tanzu bileşenleri artık yalnızca yan yana çalışan ürünler değil, birbirine sıkı sıkıya entegre edilmiş bir Platform Stack’i oluşturmaktadır.

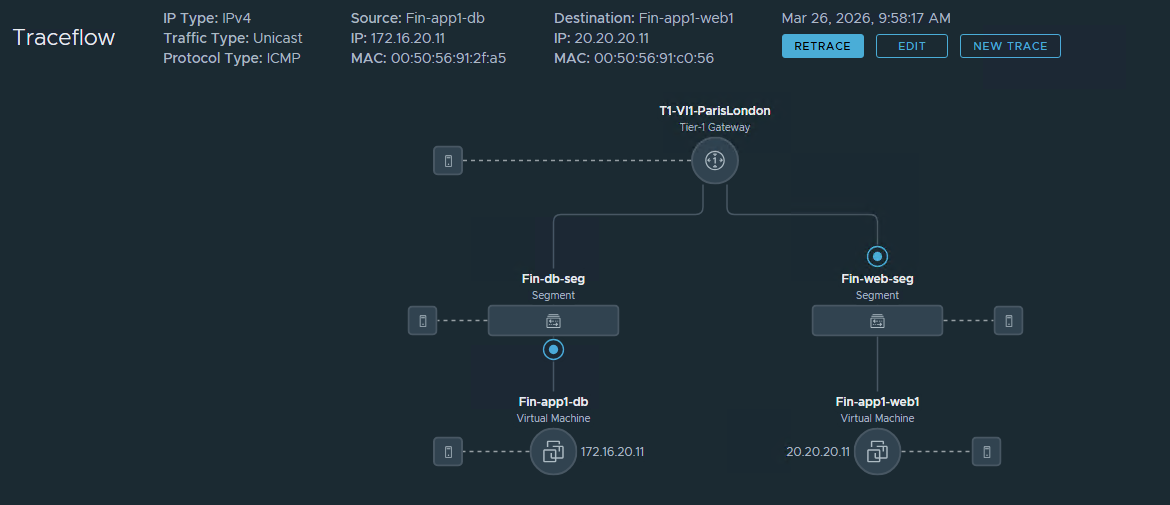

Teknik açıdan VCF 9’ın getirdiği en kritik yeniliklerden biri, Tanzu Kubernetes Grid (TKG) ile vSphere altyapısı arasındaki entegrasyonun derinleşmesidir. Bu entegrasyon sayesinde Kubernetes Cluster’larının yaşam döngüsü yönetimi, doğrudan vCenter üzerinden ve altta yatan altyapıyla tam uyum içinde gerçekleştirilebilir. Storage politikaları vSAN üzerinden Kubernetes Persistent Volume’larına otomatik olarak uygulanabilir; NSX tabanlı Micro-segmentation politikaları Container Workload’larını da kapsayacak şekilde genişletilebilir. Bu yaklaşım, OpenShift’in ayrı bir katman olarak çalıştığı modele kıyasla çok daha düşük operasyonel yük anlamına gelmektedir.

VCF 9 ayrıca Aria Suite entegrasyonunu güçlendirerek Observability, Automation ve Governance kapasitelerini tek bir penceye taşımaktadır. Sanal makineleri, Container’ları, ağ akışlarını ve depolama performansını tek bir Observability düzleminden izleyebilmek, hem operasyon ekipleri hem de güvenlik ekipleri için oyun değiştirici bir avantajdır. Özellikle Compliance ve Governance gereksinimlerinin yoğun olduğu sektörlerde — finans, sağlık, kamu — bu birleşik görünürlük kritik önem taşımaktadır.

OpenShift’ten VCF 9’a Geçiş: Teknik Yol Haritası

Red Hat OpenShift ortamından VMware Cloud Foundation 9’a geçiş, dikkatli bir planlama ve aşamalı bir yaklaşım gerektirmektedir. Bu geçişin teknik boyutları birkaç kritik alan etrafında şekillenmektedir.

İlk ve en önemli adım, mevcut Workload envanterinin çıkarılmasıdır. Hangi uygulamaların Container’larda çalıştığı, hangi Persistent Volume’ların kullanıldığı, mevcut Service Mesh konfigürasyonları ve CI/CD pipeline bağımlılıklarının eksiksiz belgelenmesi gerekmektedir. OpenShift’e özgü operatörler veya API’lar kullanan uygulamalar için uyumluluk değerlendirmesi yapılmalı; Cloud Native uygulama mimarisine uygun olanlar Tanzu ortamına taşınmadan önce gerekli adaptasyonlar planlanmalıdır.

İkinci kritik alan, ağ mimarisinin dönüşümüdür. OpenShift’in OVN-Kubernetes tabanlı ağ modeli, VCF 9 ortamında NSX tabanlı ağ politikalarıyla uyumlu hale getirilmelidir. Bu süreçte Load Balancer konfigürasyonları, Ingress Controller politikaları ve Service Mesh (genellikle Istio tabanlı) yapılandırmaları yeniden değerlendirilmelidir. NSX’in sunduğu Micro-segmentation ve distributed Firewall kapasiteleri, bu geçişi güvenlik açısından aslında bir fırsata dönüştürmektedir.

Storage katmanı geçişi de önemli bir planlama gerektirmektedir. OpenShift’te kullanılan Persistent Volume’ların vSAN tabanlı Storage Policy’lerle yönetilen yapıya aktarılması, RTO ve RPO hedefleri gözetilerek planlanmalıdır. VCF 9’ın vSAN Express Storage Architecture (ESA) özelliği, özellikle yüksek performanslı veritabanı ve AI/ML Workload’ları için önemli avantajlar sunmaktadır.

Geçiş sürecinde bir diğer kritik husus, DevOps ve GitOps pipeline’larının adaptasyonudur. OpenShift’te Tekton veya Jenkins tabanlı kurulmuş CI/CD pipeline’ları, VCF 9 Tanzu ortamında Kubernetes-native araçlarla uyumlu hale getirilmelidir. Tanzu’nun GitOps desteği, mevcut Git repository yapısıyla entegrasyon açısından güçlü bir zemin sunmaktadır.

Rakamlarla VCF 9 Geçişinin İş Değeri

Broadcom’un referans mimarileri ve partner ekosisteminden gelen vaka çalışmaları, OpenShift’ten VCF 9’a geçiş yapan organizasyonların operasyonel maliyetlerinde kayda değer iyileşmeler yaşadığını ortaya koymaktadır. Ayrı yönetim araçlarının konsolide edilmesiyle yönetim aracı lisans maliyetlerinde önemli düşüşler gözlemlenmekte; Automation ve Orchestration kapasitelerinin artmasıyla tekrarlayan operasyonel görevlerin önemli bir bölümünün otomatize edilebildiği görülmektedir.

Güvenlik cephesinde ise NSX’in distributed Firewall ve Micro-segmentation özellikleriyle birlikte Carbon Black entegrasyonu, Endpoint ve Workload güvenliğini tek bir Platform üzerinden yönetmeyi mümkün kılmaktadır. Bu durum, özellikle Ransomware ve Malware tehditlerine karşı savunma derinliğini artırmakta; Zero Trust mimarisine geçiş için güçlü bir teknik temel oluşturmaktadır. Ayrı güvenlik araçlarının konsolide edilmesiyle güvenlik operasyonlarında verimlilik artışı sağlanmakta ve Compliance süreçleri hızlanmaktadır.

Disaster Recovery ve Business Continuity cephesinde VCF 9, vMotion ile canlı Workload migrasyonu, Site Recovery Manager entegrasyonu ve NSX tabanlı ağ soyutlaması sayesinde çok daha güçlü DR senaryoları sunmaktadır. OpenShift ortamında ayrı araçlarla yönetilen DR süreçleri, VCF 9’da altyapı düzeyinde entegre bir şekilde ele alınabilmektedir. Bu entegrasyon sayesinde RTO ve RPO hedeflerinin karşılanması kolaylaşmakta, DR tatbikatlarının maliyeti ve karmaşıklığı azalmaktadır.

Sovereign Cloud ve Data Sovereignty Bağlamında VCF 9

Türkiye dahil pek çok ülkede giderek güçlenen veri egemenliği düzenlemeleri, Sovereign Cloud ve Data Sovereignty kavramlarını kurumsal IT gündeminin üst sıralarına taşımıştır. KVKK başta olmak üzere çeşitli sektörel regülasyonlar, kurumsal verilerin yurt içinde tutulmasını ve denetlenmesini zorunlu kılmaktadır. Bu çerçevede VMware Cloud Foundation 9’ın Private Cloud ve Hybrid Cloud senaryolarındaki özellikleri özellikle kritik bir anlam taşımaktadır.

VCF 9, on-premises ortamlarda tam kontrollü bir Private Cloud kurulumuna olanak tanırken, belirli Workload’ların Public Cloud’a taşınmasına imkân veren esnek Hybrid Cloud politikalarını da desteklemektedir. Sovereign Cloud gereksinimlerine uymak zorunda olan finans kuruluşları, kamu kurumları ve sağlık organizasyonları için bu esneklik, hem Compliance’ı hem de inovasyon kapasitesini aynı anda koruma fırsatı sunmaktadır. Öte yandan Kubernetes Workload’larının da bu Sovereign Cloud çerçevesine dahil edilebilmesi, container stratejisini veri egemenliği gereksinimleriyle bütünleştirmeyi kolaylaştırmaktadır.

Sonuç: Türk IT Ekosistemi İçin Stratejik Çıkarımlar

Red Hat OpenShift’ten VMware Cloud Foundation 9’a geçiş eğilimi, küresel ölçekte hız kazanırken Türkiye’deki kurumsal IT organizasyonları için de önemli stratejik kararları beraberinde getirmektedir. Özellikle bankacılık, telekomünikasyon, enerji ve kamu sektörlerinde faaliyet gösteren büyük organizasyonlar, mevcut Container Platform stratejilerini ve operasyonel modellerini VCF 9’ın sunduğu Unified Cloud Operating Model bağlamında yeniden değerlendirmelidir.

Bu değerlendirme sürecinde göz önünde bulundurulması gereken başlıca faktörler şunlardır: Mevcut OpenShift ortamının ölçeği ve karmaşıklığı, operasyonel silolaşmanın yarattığı maliyet ve verimlilik kayıpları, Sovereign Cloud ve Compliance gereksinimlerinin kapsamı, Disaster Recovery ve Business Continuity hedefleri ile Kubernetes ve sanal makine Workload’larının birlikte yönetilmesinin stratejik önemi.

Türkiye’de Broadcom Knights ekosisteminin güçlenmesiyle birlikte yerel Partner’ların VCF 9 geçiş yetkinlikleri de artmaktadır. Bu durum, geçiş projelerini daha erişilebilir ve risk yönetilebilir kılmaktadır. Sonuç olarak Unified Cloud Operating Model, bir ürün değişikliğinden çok operasyonel ve stratejik bir dönüşümü temsil etmektedir; bu dönüşümü erkenden değerlendiren organizasyonlar, orta vadede hem operasyonel verimlilik hem de güvenlik olgunluğu açısından önemli avantajlar elde edecektir.